详解数据服务共享发布与数据处理服务 构建高效数据生态的双引擎

在数字化转型浪潮中,数据已成为核心生产要素。如何安全、高效地管理、处理并释放数据价值,是各类组织面临的共同课题。数据服务共享发布与数据处理服务,作为现代数据架构中的两大关键组件,共同构成了驱动数据价值流转与业务创新的双引擎。本文将深入解析二者的核心内涵、技术实践及协同关系。

一、 数据处理服务:数据的“炼金术”

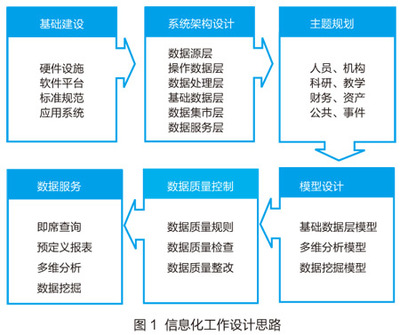

数据处理服务专注于对原始数据进行一系列加工、转换与整合,将其转化为可供分析或应用的高质量、结构化数据。它是数据价值链中的核心生产环节。

- 核心目标:提升数据的可用性、一致性、准确性与时效性,为上层的数据消费(如分析、共享、应用开发)奠定坚实基础。

- 主要范畴:

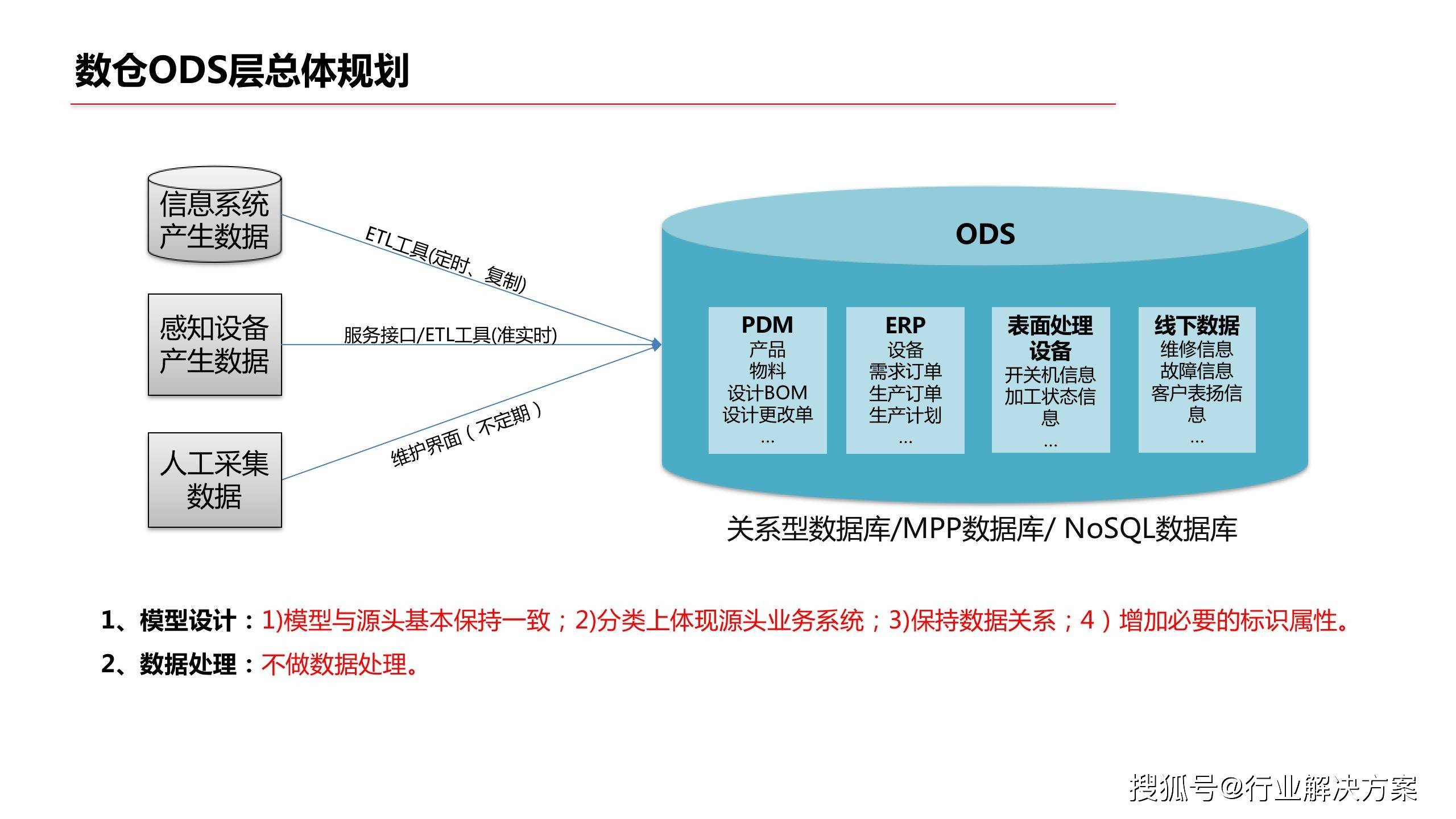

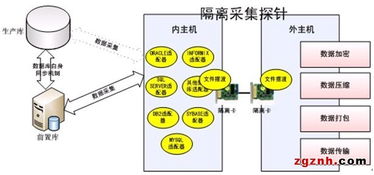

- 数据集成:从异构数据源(数据库、API、文件等)抽取、清洗、转换并加载(ETL/ELT)到统一的数据仓库或数据湖。

- 数据开发与治理:进行数据建模、质量校验、血缘追踪、元数据管理等,确保数据处理过程的可控、可信与可审计。

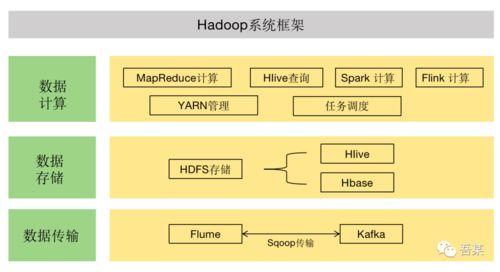

- 实时处理:通过流式计算技术(如Flink, Spark Streaming)对实时数据流进行即时处理与分析,满足实时监控、预警等场景需求。

- 数据计算与挖掘:执行复杂的批处理计算、机器学习模型训练与推理,从数据中提炼深层洞察。

- 关键特征:强调过程的可靠性、性能与成本控制,通常在企业内部的数据平台或云端大数据服务中完成。

二、 数据服务共享发布:价值的“传送门”

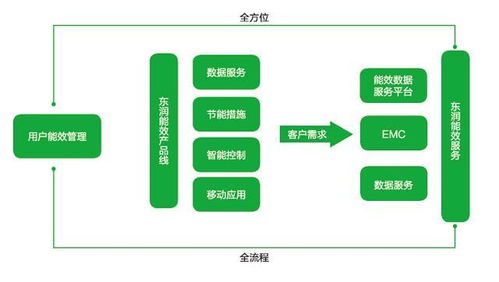

数据服务共享发布则聚焦于将处理好的数据,以安全、便捷、标准化的方式“产品化”并交付给内外部用户或应用系统。它是连接数据生产与消费的桥梁。

- 核心目标:实现数据资产的可发现、可理解、可访问与可复用,促进数据在组织内乃至生态间的安全流通与价值兑现。

- 主要实现形式:

- API服务化:将数据或数据能力封装成标准的API(如RESTful API),供应用系统按需调用。这是目前最主流的共享发布方式。

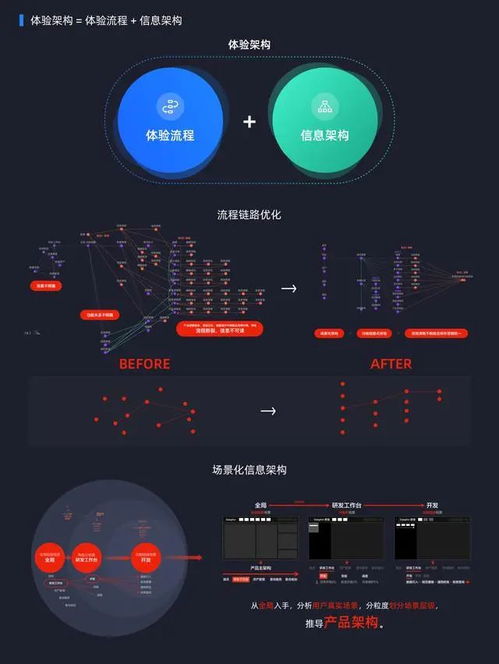

- 数据产品目录/市场:建立统一的数据资产目录,对数据服务进行编目、描述和分类,使用者可以像在应用商店一样浏览、申请和订阅所需数据服务。

- 数据文件/数据库共享:在严格权限控制下,通过安全通道提供数据文件下载或数据库查询访问。

- 分析报表共享:将处理后的分析结果以可视化报表、仪表盘等形式发布给业务人员。

- 关键特征:强调用户体验、访问控制、计量计费、服务等级协议(SLA)以及合规性(如数据脱敏、隐私保护)。

三、 双引擎协同:从数据到价值的闭环

数据处理服务与数据服务共享发布并非孤立存在,而是紧密衔接、循环增强的关系,共同构成数据运营的完整闭环。

- 流水线式协作:数据处理服务是“上游工厂”,负责生产高质量的“数据半成品或成品”;数据服务共享发布是“下游渠道与门店”,负责包装、上架并安全地交付给最终“消费者”。没有高质量的处理,共享的数据将失去价值基础;没有高效的共享,处理的数据将无法发挥价值。

- 需求驱动反馈:数据服务共享平台收集到的用户访问行为、性能反馈、新的数据需求,可以反向驱动数据处理服务的优化与迭代,例如增加新的数据清洗规则、开发新的数据模型或提升处理性能以满足SLA。

- 平台化整合趋势:先进的数据中台或数据网格(Data Mesh)架构,正致力于将二者无缝整合。在一个统一的平台上,数据团队可以完成从数据接入、开发、治理到服务封装、发布、运维的全链路管理,实现“一次开发,多处共享”。

四、 实践建议与展望

对于希望构建高效数据能力的组织,建议:

- 统一规划:将数据处理与数据服务共享纳入整体数据战略,明确各自团队职责与协作流程。

- 标准先行:建立统一的数据模型规范、API设计规范、数据安全与隐私标准。

- 技术选型:选用支持从处理到发布全生命周期的数据平台或套件,减少集成复杂度。

- 运营思维:将数据服务视为产品进行运营,关注用户体验、服务质量与价值度量。

随着数据要素市场化配置的深入,数据服务共享发布将更加注重跨组织、跨域的安全可信流通(如通过隐私计算技术)。数据处理服务则将更智能化,融合更多AI能力进行自动化的质量提升与价值挖掘。二者深度融合,将持续赋能数字经济,释放前所未有的数据潜能。

如若转载,请注明出处:http://www.fpcnt.com/product/9.html

更新时间:2026-05-25 04:21:08